NANDはなくならないが、AIサーバーはもはやフラッシュだけに依存していない

20年以上にわたり、GetUSBはデータが実際にどのように動くのかを追い続けてきました。単なるマーケティング上の説明ではなく、現実の挙動を見てきたという意味です。その間に、ストレージは何度も大きな変化を経験してきました。回転ディスクの衰退からフラッシュの台頭、そして最近ではストレージが単なる受動的な部品ではなく、インフラそのものの一部として機能するシステムへと進化しています。

現在AIインフラで起きていることも、そうした転換点のひとつに見えますが、今回はそれを押し進めている圧力の種類がこれまでとは少し違います。

NANDフラッシュがなくなるわけではありませんし、その点について議論の余地はほとんどありません。現代のストレージの基盤であり、その役割を非常にうまく果たしています。一方で、NANDの需要は急激に増加しています。主な理由は、巨大なデータセットと継続的なアクセスを必要とするAIワークロードです。この需要は、価格の上昇や供給制限、あるいは大規模導入におけるリードタイムの長期化といった形で、無視できないレベルで供給とぶつかり始めています。

こうした不均衡が見え始めると、業界は状況が自然に落ち着くのを待つことはしません。別の解決策を探し始めます。そしてそこから変化が始まります。

多くの人が前提としていること

外から見れば、そのロジックは依然として理にかなっているように見えます。AIモデルは大規模化し、データセットは拡張し続け、それを支えるインフラも増えている。だから単純にストレージを増やせばいい、という発想になります。SSDを増やし、容量を増やし、ラック内のフラッシュを増やせば、システムは追いつくはずだと考えるわけです。

この考え方は長い間機能してきましたし、今でも多くの環境では有効です。ただし、その前提には「AIワークロードでもストレージは従来と同じように振る舞う」という考えがあります。ここから少しずつズレが生まれていきます。

さらに、この前提はNANDが必要な量で、予測可能な価格で供給され続けることも前提としていますが、需要の加速によりその確実性は低下しています。

NANDが限界を見せ始めるところ

NANDフラッシュは本来の設計目的において非常に優れています。高密度で信頼性が高く、比較的高速なストレージを提供し、従来技術が抱えていた多くの問題を解決してきました。現在でも多くのワークロードにおいて、期待通りに動作しています。

しかしAIワークロードは少し異なるものを要求しており、その違いは想像以上に重要です。

単にデータを保存して必要なときに取り出すのではなく、これらのシステムは大量の並列計算リソースへ継続的にデータを供給する必要があります。その速度は、従来のストレージアーキテクチャでは安定して維持するのが難しいレベルです。高性能SSDはバーストや大きなキューには対応できますが、数千のGPUコアにリアルタイムでデータを供給するのは全く別の要求です。

同時に、その基盤であるNAND自体も高価になりつつあり、大量調達が難しくなるケースも出てきています。つまり業界は、より高く安定したスループットの必要性と、それを担う媒体がコストと供給の両面で圧力を受けているという、二重の課題に直面しています。

この組み合わせが現在の変化を生んでいます。NANDが使えなくなったからではなく、それだけに頼るのではAIシステムの要求に追いつけなくなっているからです。

業界はNANDを置き換えたのではなく、その周りに構築した

AIインフラで起きているのは、NANDの完全な置き換えではありませんし、フラッシュが突然消えるような変化でもありません。むしろNANDは依然として中心にあります。ただし、すべての負荷を単独で担うことは期待されなくなっています。

その代わりに、NANDの周囲に追加のレイヤーが構築されています。それぞれが、NAND単体では対応しきれないワークロードの一部を担うために設計されています。実際には、データの流れ方、各段階での配置、そして計算側の要求に応じたアクセス速度を再設計することを意味します。

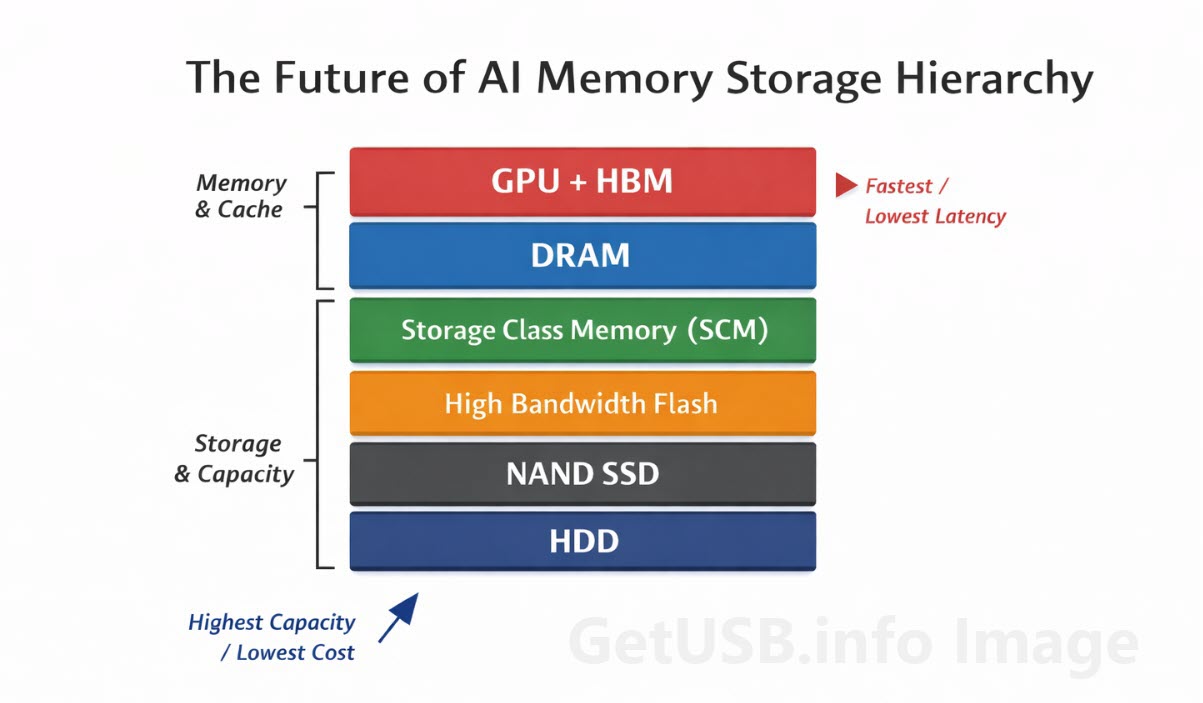

ここで「メモリスタック」という考え方が登場します。これはマーケティング用語ではなく、実際の構成を説明するためのものです。ストレージとメモリを別物として扱うのではなく、速度・コスト・プロセッサへの近さに応じて異なる振る舞いをする複数の層として扱います。

NANDは依然として容量の面で重要な役割を果たしていますが、レイテンシや帯域がより重要になる部分では、他の技術と並んで使われるようになっています。

NANDの周囲で構築されているもの

このように見ると、変化はより理解しやすくなります。NANDにすべてを任せるのではなく、特定の問題を解決するためのレイヤーが追加されています。すでに実運用されているものもあれば、進化中のものもありますが、これらが組み合わさることで、現代のAIサーバーが依存する構造が形作られています。

今後の記事ではそれぞれのレイヤーを個別に掘り下げていきます。それぞれが独立して詳しく説明されるべき内容だからです。ここでは全体像を理解することに焦点を当てます。

High Bandwidth Memory(HBM)

スタックの最上部、GPUに最も近い位置にあるのがHBMです。これは積層型DRAMで、プロセッサのすぐ近くに配置され、非常に高い帯域と低いレイテンシを実現します。従来のストレージではなく、GPUに必要な速度でデータを供給するための特殊なメモリです。

HBMは容量ではなく、GPUを止めないことに焦点があります。AIシステムではGPUが最も高価な要素であることが多く、データ待ちが発生すると全体効率が下がります。HBMはその問題を帯域と近接性で解決します。

倉庫に例えると、HBMは次に出荷するパレットがすでにドックに置かれていて、すぐ動かせる状態にあるようなものです。全体在庫を増やすのではなく、フォークリフトが待たない状態を作ります。

HBMと新しい代替技術の比較については、こちらで詳しく解説しています:HBM vs HBF: Why the Memory Hierarchy is Being Stretched

Storage Class Memory(SCM)

その下にあるのが、数年前まではほとんど実用化されていなかった領域、つまりメモリのように振る舞うストレージです。

SCMはDRAMとNANDの間を埋めます。純粋なメモリほど速くはなく、フラッシュほど高密度でもありませんが、大規模DRAMのコストをかけずに、NANDより高速なアクセスを必要とするワークロードに適したバランスを提供します。

AI環境では、この中間層がNANDへの負荷を緩和し、特に大規模データセットの処理において重要な役割を果たします。

倉庫の例では、SCMは棚とドックの間の仕分けエリアです。すべては棚にありますが、そこへ何度も取りに行くのは遅すぎる。ドックは速いが狭い。その間にあるSCMが、次に必要なものを準備して流れを維持します。

High Bandwidth Flash

ここが特に興味深い部分で、まったく新しいメモリを導入するだけでなく、NAND自体を新しい領域に押し上げようとする動きもあります。

High Bandwidth Flashは、フラッシュを従来のストレージではなく、メモリの延長のように扱う試みです。NANDを置き換えるのではなく、アクセス方法と統合方法を変えることで、より効率的にデータを上位層へ供給します。

これはNANDが新しい環境に適応しているとも言えます。技術は一夜にして消えるのではなく、進化していくものです。

DRAMとその限界

DRAMも依然として中心的な役割を担っており、なくなることはありません。AIサーバーを含むほとんどのシステムで主要な作業メモリとして機能しています。

ただし、DRAMを無限に拡張することは現実的ではありません。コスト、消費電力、物理的制約が問題になります。そのため、追加のレイヤーが必要になります。

倉庫で言えば、DRAMは作業が行われるドックそのものです。しかしスペースには限界があり、すべてをそこで処理するのは非効率になります。

ハードディスクの静かな復活

高速メモリやフラッシュに注目が集まる中でも、従来のハードディスクは依然として重要です。特にコスト重視の層では不可欠です。

AIは膨大なデータを扱いますが、すべてが高速ストレージにある必要はありません。アーカイブや低頻度データはHDDが担います。

パフォーマンスでは競合しませんが、全体負荷を軽減します。

ストレージに近づくコンピュート

データ移動距離を減らすという考えも重要になっています。データの場所に処理を近づける設計です。

これによりボトルネックが減り、効率が向上します。

AIコンテキスト(KVキャッシュ)の役割

AIモデルは実行中に大量の一時データを生成します。これがKVキャッシュです。

これらは従来のメモリに収まりきらず、ストレージをメモリの延長として扱う必要が出てきます。

倉庫で言えば、作業中のチェックリストのようなものです。これが乱れると全体が遅くなります。

新しいAIメモリスタック

全体を見ると、単純な階層ではなく多層構造です。

上からHBM、DRAM、SCM、フラッシュ、そしてHDDが役割分担します。

倉庫での役割分担と同じで、それぞれが適した場所で機能します。

この組み合わせがAIに適した構造を作ります。

今後の意味

NANDが消えるわけではありません。

重要なのは複数レイヤーの協調です。

ストレージの考え方が変わっています。

NANDは依然重要ですが、唯一ではありません。

Tags: AIインフラ, AIメモリスタック, HBM, NANDフラッシュ, ストレージクラスメモリ