ストレージクラスメモリ解説:DRAMとNANDの間にある欠けていたレイヤー

AIシステムが実際にどのようにデータを動かしているのかを見ていくと、問題は単にプロセッサを速くすることやストレージ容量を増やすことだけではなく、その間にある層で何が起きているのか、そしてシステムがどれだけの頻度で待たされているのかという点にあることに、わりとすぐ気づきます。

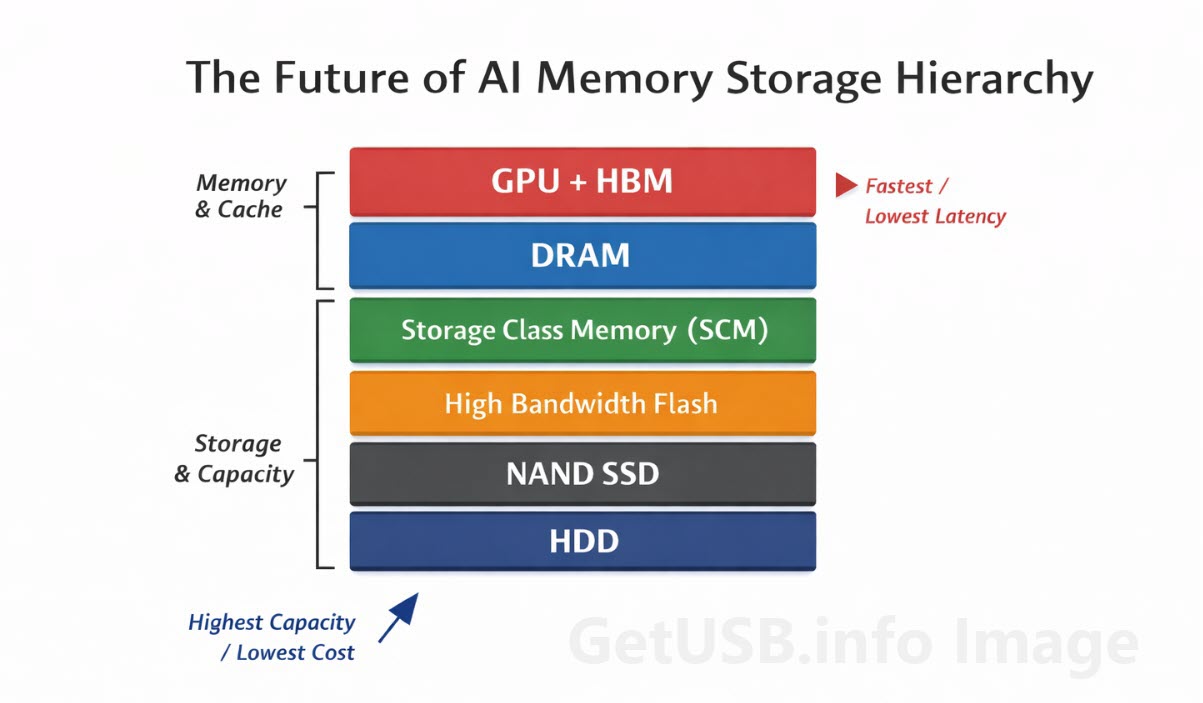

前回のHigh Bandwidth Memoryの記事では、GPUが止まらないようにデータをできるだけプロセッサの近くに置くことに焦点を当てていました。これはスタックの最上部にあたる重要な部分ですが、そこにすべてを置けるわけではないため、問題の一部しか解決しません。

作業データの量がその即時レイヤーに収まりきらなくなると、結局またDRAMとNANDの間でデータをやり取りすることになります。そしてまさにそのあたりから、バランスの悪さが見えてきます。DRAMは速くて反応も良いですが、高価で無制限に増やすことはできません。一方でNANDは容量面では現実的ですが、優れたフラッシュでも連続した負荷の中では無視できない遅延が発生します。

この2つの間にある隙間こそが、ストレージクラスメモリの出番になる場所です。どちらかを置き換える新しい技術というよりは、データの受け渡しを滑らかにして、システムが「非常に速い」と「明らかに遅い」の間を行き来し続けないようにするための層といえます。

こうしたレイヤー構造がなぜ生まれてきているのか、全体像を理解するには、こちらのメイン記事もあわせて読むとつながりが見えてきます:NANDはなくならないが、AIサーバーはもはやフラッシュだけに依存していない。